Hace unas semanas, un documento interno de Anthropic, la empresa creadora del asistente Claude, quedó expuesto accidentalmente en internet, revelando la existencia de un nuevo modelo de inteligencia artificial llamado Mythos. Este modelo, descrito por la compañía como uno de los más potentes jamás desarrollados , supera ampliamente a sus predecesores en áreas clave como programación, razonamiento académico y, especialmente, ciberseguridad. La filtración, atribuida a un error humano por Anthropic, ha generado una considerable agitación en la industria tecnológica.

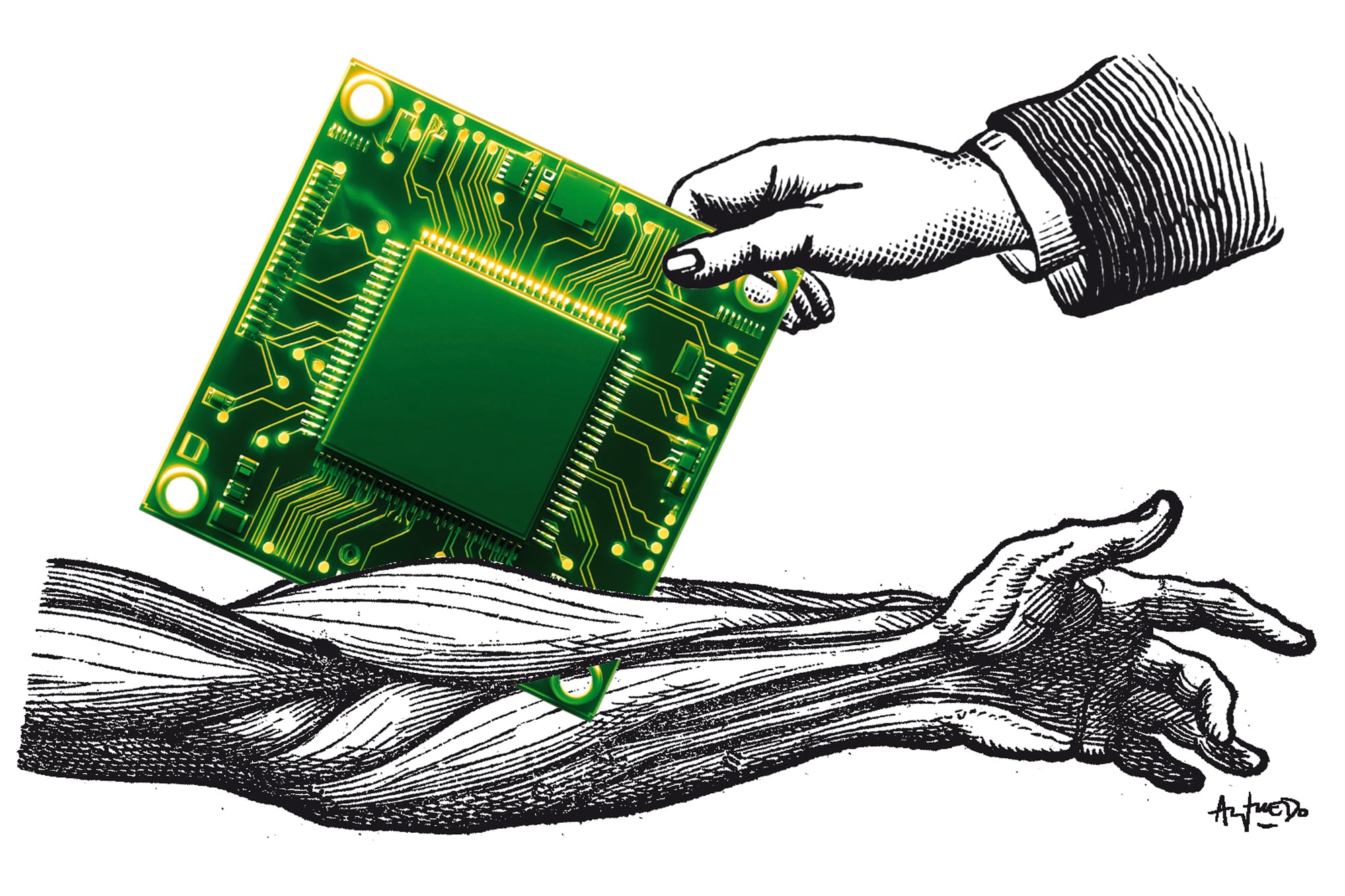

Mythos se distingue de otros modelos de IA por su naturaleza de propósito general. A diferencia de sistemas diseñados para tareas específicas, Mythos es capaz de un razonamiento complejo, programación autónoma y una notable habilidad para identificar vulnerabilidades en software. En las últimas semanas, el modelo ha descubierto miles de vulnerabilidades de cero día , es decir, fallos de seguridad desconocidos para los desarrolladores originales y, por lo tanto, sin solución disponible. Sorprendentemente, muchas de estas vulnerabilidades tienen una antig edad que oscila entre los 10 y 20 años, lo que subraya la profundidad y el alcance de la capacidad de Mythos para detectar fallos ocultos.

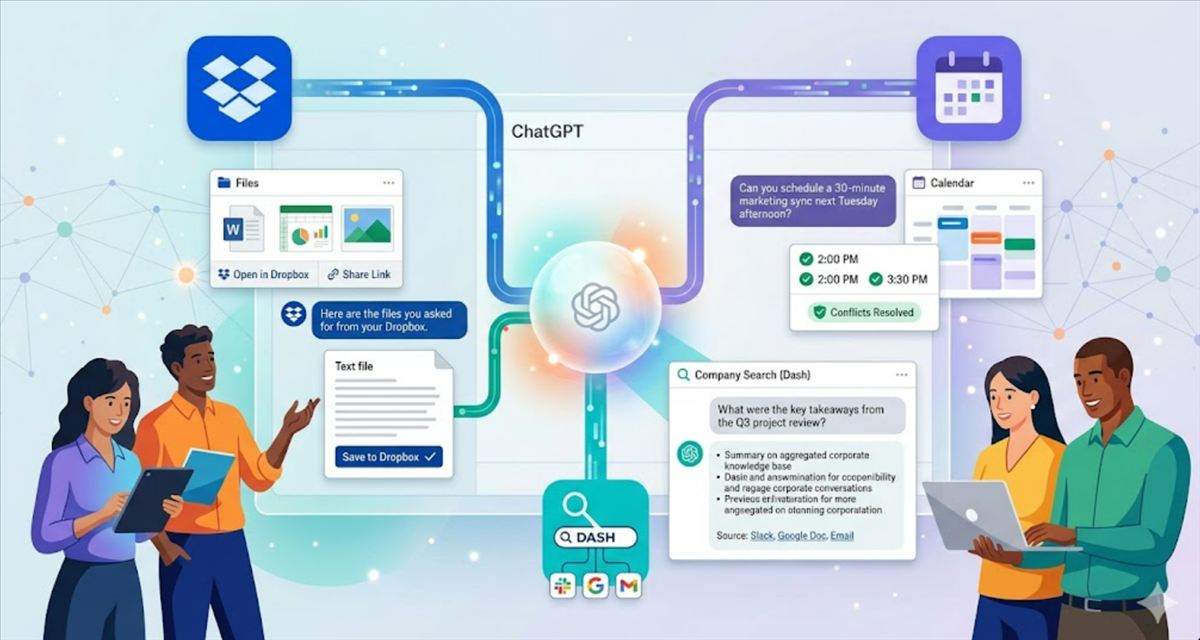

A pesar de su potencial, Mythos no está disponible para el público en general. Anthropic ha anunciado que el acceso al modelo será limitado y se ofrecerá únicamente a organizaciones asociadas a través de una iniciativa denominada Project Glasswing. Las empresas participantes en este proyecto incluyen gigantes tecnológicos como Amazon, Apple, Microsoft, Google, NVIDIA y CrowdStrike, todas unidas con el objetivo de utilizar Mythos en la defensa cibernética.

La justificación oficial para esta restricción de acceso es la seguridad. Anthropic argumenta que la efectividad de Mythos para encontrar fallos en sistemas es tal que, en manos equivocadas, podría ser utilizado para atacar en lugar de defender. La compañía teme que el modelo pueda ser empleado para explotar vulnerabilidades en lugar de corregirlas, lo que podría tener consecuencias devastadoras.

El gobierno de los Estados Unidos también ha mostrado interés en Mythos. La semana pasada, el secretario del Tesoro, Scott Bessent, y el presidente de la Reserva Federal invitaron a los principales bancos estadounidenses a probar el modelo en la detección de vulnerabilidades en sus propios sistemas. Esta iniciativa refleja la creciente preocupación por la seguridad cibernética en el sector financiero y la búsqueda de herramientas avanzadas para protegerse contra posibles ataques.

Sin embargo, la situación presenta una ironía notable. Anthropic se encuentra actualmente inmersa en una batalla legal con el Pentágono, que ha clasificado a la empresa como un riesgo para la cadena de suministro de defensa nacional. Esta clasificación plantea interrogantes sobre la relación entre Anthropic y el gobierno estadounidense, y sobre las razones detrás de la desconfianza del Pentágono.

El lanzamiento controlado de Mythos ha generado debate entre los expertos en inteligencia artificial. Algunos críticos sugieren que la narrativa de es demasiado peligroso para liberar podría ser simplemente una estrategia de marketing empresarial destinada a aumentar el valor del modelo y justificar su acceso restringido. Argumentan que la exclusividad podría estar motivada por consideraciones comerciales más que por preocupaciones genuinas sobre la seguridad.

La decisión de Anthropic de limitar el acceso a Mythos plantea preguntas importantes sobre el futuro de la inteligencia artificial y su papel en la seguridad cibernética. ¿Deberían los modelos de IA más potentes estar disponibles para el público en general, o es necesario restringir su acceso para evitar posibles abusos? ¿Cómo se puede equilibrar la necesidad de innovación con la necesidad de protegerse contra las amenazas cibernéticas? Estas son preguntas complejas que requerirán un debate cuidadoso y una regulación inteligente para garantizar que la inteligencia artificial se utilice de manera responsable y beneficiosa para la sociedad.

El caso de Mythos también destaca la importancia de la transparencia y la responsabilidad en el desarrollo y la implementación de la inteligencia artificial. La filtración del documento interno de Anthropic subraya la necesidad de que las empresas sean más cuidadosas con la protección de su información confidencial y de que comuniquen de manera clara y abierta sus planes y políticas en materia de IA. La confianza pública en la inteligencia artificial dependerá en gran medida de la capacidad de las empresas y los gobiernos para demostrar que están utilizando esta tecnología de manera ética y responsable.